- كيف تختار خادمًا للـ AI في 2026

- تقسيم المهام: Training vs Inference

- المكونات الرئيسية لخادم AI

- جدول مقارنة GPU

- البنية التحتية للشبكة

- التبريد والطاقة

- الخلاصة

نحن جاهزون لمساعدتك

كيف تختار خادمًا للـ AI في 2026: المعمارية والعتاد وحساب القدرة

خلاصات سريعة:

- اختيار خادم AI يعتمد بشكل صارم على المهمة: في Training يكون عرض نطاق interconnect (NVLink) وحجم VRAM عاملين حاسمين، وفي Inference تكون الأولوية لزمن الاستجابة المنخفض وأداء tensor (TOPS/TFLOPS).

- المعالجات الرسومية (GPU) هي أساس AI. يتم الاختيار حول بنية المسرّعات (مثل NVIDIA Hopper/Blackwell أو AMD Instinct) وعلاقتها بالـ CPU.

- مشكلة «Bottleneck» في التخزين تُحل فقط عبر مصفوفات NVMe SSD بواجهة PCIe 5.0/6.0 قادرة على تغذية GPU بالبيانات بشكل مستمر.

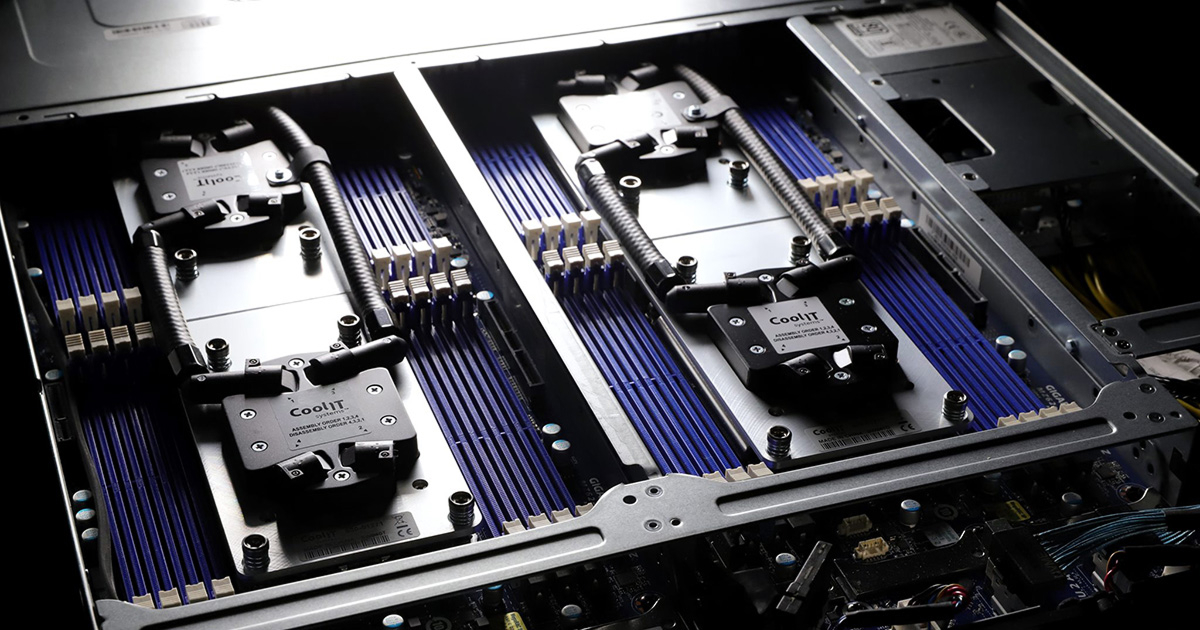

- استهلاك الطاقة لخادم AI حديث واحد (بناءً على 8x GPU) قد يصل إلى 10-12 kW، ما يتطلب أنظمة تبريد سائل (DLC).

1. تقسيم المهام: Training vs Inference

قبل اختيار التكوين، يجب تحديد نوع حمل AI. خادم بناء الشبكات العصبية يختلف جذريًا عن خادم تشغيلها.

- Training: عملية إنشاء النموذج (LLM، توليد الصور). تتطلب قدرات حسابية هائلة، وحجم VRAM ضخم لتخزين الأوزان، واتصالًا فائق السرعة بين عدة GPU.

- Inference: استخدام نموذج مدرّب بالفعل للرد على طلبات المستخدمين. هنا تكون سرعة الاستجابة (Latency) وكفاءة الطاقة وإمكانية المعالجة المتوازية لآلاف الطلبات الصغيرة أهم. غالبًا ما تكفي خوادم تحتوي على 1-4 GPU أقل قوة (مثل NVIDIA L40S أو RTX Ada Generation).

2. المكونات الرئيسية لخادم AI

معمارية خادم AI تُبنى حول المسرّعات الرسومية، لكن بدون توازن صحيح لباقي المكونات ستبقى GPU المكلفة في انتظار البيانات.

المسرّعات الرسومية (GPU)

GPU هو قلب الذكاء الاصطناعي. وعلى عكس CPU الذي يملك عشرات الأنوية، تمتلك GPU عشرات الآلاف من الأنوية الصغيرة، وهي مثالية للحسابات المصفوفية المتوازية.

- حجم VRAM: لتشغيل LLM المفتوحة (مثل Llama 3 70B) يلزم نحو 40-80 GB VRAM (بحسب quantization). أما تدريب النماذج ذات المليارات من المعاملات فيحتاج خوادم بذاكرة إجمالية تبدأ من 640 GB (مثل تجميعات 8x NVIDIA H100 80GB أو B200).

- Interconnect: إذا كان في الخادم أكثر من 2 GPU، يصبح الاتصال عبر PCIe القياسي bottleneck. يجب اختيار منصات بتقنيات تبادل بيانات مباشر وعالي السرعة بين البطاقات (NVIDIA NVLink / NVSwitch أو AMD Infinity Fabric).

المعالج المركزي (CPU)

في خادم AI، مهمة CPU هي Data Preprocessing، وتنظيم المهام، وتوجيه حركة الشبكة.

- المتطلبات: يُوصى بتركيب معالجين عاليَي التردد (Intel Xeon Scalable الجيل 5/6 أو AMD EPYC الجيل 4/5) مع عدد كبير من خطوط PCIe للربط المباشر مع أقراص NVMe وبطاقات الشبكة.

الذاكرة RAM

- قاعدة الحساب: يجب أن يكون حجم RAM النظامي ضعف إجمالي VRAM لكل البطاقات المركبة على الأقل. إذا كان الخادم يحتوي 8 GPU بسعة 80 GB لكل بطاقة (إجمالي 640 GB VRAM)، فستحتاج من 1.5 إلى 2 TB من DDR5 مع ECC.

منظومة التخزين (Storage)

تعلم الآلة يتطلب قراءة مستمرة لبيانات ضخمة جدًا. استخدام HDD أو SATA SSD البطيء غير مقبول — ستبقى GPU خاملة حتى 90% من الوقت.

- المعيار: فقط أقراص U.2/U.3 أو E1.S/E3.S NVMe SSD مخصصة للخوادم مع دعم PCIe 5.0. يجب أن تكون سرعة قراءة المصفوفة من 30 إلى 60 GB/s.

3. جدول مقارنة: اختيار GPU لمهام AI (محدّث لعام 2026)

| موديل GPU | سعة الذاكرة (VRAM) | الاستخدام الأساسي | استهلاك الطاقة | المميزات |

|---|---|---|---|---|

| NVIDIA B200 / GB200 | 192 GB (HBM3e) | تدريب LLM ثقيلة (بمستوى GPT) | 1000 W+ | عرض نطاق هائل، تبريد سائل. |

| NVIDIA H100 / H200 | 80 GB / 141 GB | حل شامل: Training و Inference معقد | 700 W | معيار الصناعة لمراكز البيانات. |

| AMD Instinct MI300X | 192 GB | Training و Inference للنماذج الكبيرة | 750 W | بديل اقتصادي مع buffer ذاكرة ضخم. |

| NVIDIA L40S | 48 GB (GDDR6a) | Inference، تحليل فيديو، 3D-rendering | 350 W | لا يتطلب NVLink، ويتوافق ممتازًا مع خوادم PCIe القياسية. |

4. البنية التحتية للشبكة (Networking)

إذا لم تكفِ قدرة خادم واحد، يتم تجميع AI clusters داخل مراكز البيانات. لمزامنة أوزان الشبكات العصبية بين الخوادم، لا يكفي Ethernet التقليدي 10G/25G.

ستحتاج إلى محولات (SmartNIC / DPU) تدعم 400GbE أو 800GbE، إضافة إلى تقنيات InfiniBand أو RoCE v2 (RDMA over Converged Ethernet) للوصول المباشر إلى ذاكرة الخوادم الأخرى دون المرور عبر CPU.

5. التبريد والطاقة: القيود الفيزيائية لمركز البيانات

الخادم الحديث بصيغة 4U-8U والمزوّد بثمانية مسرّعات رسومية قوية يستهلك من 8 إلى 12 كيلوواط (kW) من الكهرباء.

- الطاقة: تأكد أن Rack في مركز البيانات لديك قادر على تحمّل هذا الحمل لكل وحدة. ستحتاج مزودات طاقة معززة (بدءًا من 3000 W لكل مزود مع redundancy بنمط N+N أو N+1).

- التبريد: التبريد الهوائي التقليدي (هواء الممر البارد) لم يعد كافيًا للحلول الرائدة (بمستوى Blackwell). فكّر في منصات خوادم مع دمج مصنعي لـ DLC (Direct Liquid Cooling) — تبريد سائل مباشر على شرائح CPU و GPU.

الخلاصة

اختيار خادم للذكاء الاصطناعي هو بحث عن bottlenecks. لا جدوى من شراء ثمانية من أغلى مسرّعات NVIDIA أو AMD إذا وفّرت في تخزين NVMe أو بطاقات الشبكة التي لن توفر سرعة تمرير البيانات المطلوبة. للبداية واختبارات Inference، ركز على خوادم تحتوي 1-4 بطاقات من الفئة المتوسطة (L40S / RTX 6000 Ada). أما تدريب النماذج الأساسية فاختر فقط معماريات HGX مع NVLink interconnect وهامش تبريد كافٍ.